中国荔枝种植面积、产量和产值均居世界首位,种植面积达47.57万hm²[1]。荔枝作为目前广东最重要的经济作物之一,种植面积以27.3 万hm²居全国第一,品种最为丰富,种质资源在全国乃至国际上也独具优势[2]。但是荔枝在种植过程易受到多种病虫害的侵袭,因此,快速、准确地判断荔枝病虫害类型是植保精准施药、降低损失的前提和基础[3]。传统病虫害识别和检测主要依靠人工根据经验现场观察判定的方法,存在判定效率低、成本高、受主观性影响等问题,无法满足现代农业大规模、实时检测的需求[4-6]。

随着计算机技术的发展,研究人员开始将机器学习和图像处理的方法作为对作物病虫害进行识别的一种技术手段。在作物病虫害识别研究方面,Hlaing 等[7]通过Johnson SB 分布模型对番茄图像的尺度不变特征转换(scale invariant feature transform,SIFT)特征进行建模,获得图像的纹理统计信息,结合颜色特征信息,经过支持向量机训练,平均精度可达85.1%。党满意等[8]通过将马铃薯晚疫病叶片提取的颜色、纹理及形状特征参数结合起来进行建模,识别率达90%,识别时间为9 s。卜俊怡等[9]通过提取诱虫板图像RGB 颜色模型中的B 分量和HSV 颜色模型中V 分量,利用最大类间方差法分割提取颜色、形状及纹理特征,识别率达到90.40%。上述基于传统图像处理和机器学习方法的试验,关键在于提取到丰富、准确的特征。然而,由于作物病害图像纹理、颜色等特征非常复杂且不规则,传统方法中提取的低层次特征无法应用于大量、多类目标的识别[10]。

近年来,深度学习技术在不断发展,卷积神经网络(convolutional neural network,CNN)作为深度学习的典型代表[11-12],相比于传统图像处理和机器学习的图像分类算法,卷积神经网络通过卷积操作对输入图像进行特征提取,不仅能提取到更高层、表达能力更好的特征,还能实现在一个模型中完成端到端的特征提取、选择及分类。卷积神经网络在作物叶片病虫害识别相关领域已得到广泛应用。鲍文霞等[13]利用深度语义分割网络U-Net 分割出麦穗图像,并设计了多路卷积神经网络进行小麦赤霉病的识别,识别精度超过98%;Zhang 等[14]提出了全局池化扩张卷积网络(global pooling dilated convolutional neural network,GPDCNN)用于植物病害识别,对6 种常见黄瓜叶片病害的识别精度达94.65%;Liu 等[15]通过基于全局对比度的显著性区域检测算法计算用于定位害虫的显著性图,提取目标的边界框,通过卷积神经网络对水稻害虫进行识别,平均精度达到95.1%。上述研究基于CNN 的方法通过提取农作物病害图像的深层特征,在一定程度上提高了病害识别的准确率。由于荔枝叶片病虫害的纹理形状等相近,为了能够更加准确地识别荔枝叶片病虫害类型,需要在深层特征基础上进一步利用注意力机制(attention mechanism)选择关注对目标更为关键的信息[16]。深度学习中的注意力机制源于对人类视觉的研究,通过学习的方式自适应对每张特征图的重要性进行选取,从众多特征信息中选择出对当前目标任务更为关键的信息[17]。例如,通道注意力模块SE 中通过挤压(squeeze)将每一张特征图挤压成一个具有全局信息的实数,接着经过激励(excitation)将此信息通过全连接层与激活函数放大对识别任务重要的特征图权重,缩小不重要的特征图权重[18]。坐标注意力模块(coordinate attention, CA)通过在像素坐标系上的有效定位,将位置信息嵌入到通道注意力从而捕获方向感知和位置敏感信息,最终达到更好的目标分类效果[19]。双注意力机制(DA-Net)通过综合通道和空间的特征信息对关键特征权重进行更新,将更多的注意力放在更易于进行区分的关键特征之上[20]。Junde 等[21]在轻量型神经网络模型MobileNet V2 中结合了通道注意力机(CAM),增强了对复杂背景害虫的识别能力,平均准确率达92.79%;Yun 等[22]将改进的通道和空间注意力模块嵌入到ResNet中,减少了通道之间的信息冗余,并将注意力集中在特征图中信息最丰富的区域,平均准确率超过95.37%;王美华等[23]对CBAM注意力模块进行改进并嵌入到ResNet、AlexNet 等网络中,平均准确率均得到了0.5%的提升。

上述研究通过下采样的方式逐步降低特征图尺寸(典型尺寸7×7),虽然下采样的方式能够降低运算量,但同时也伴随着分辨率的降低导致很多小特征信息的丢失,例如本研究中叶片较小面积的病斑特征。笔者通过对ShuffleNet V2 模型添加注意力模块ECA自适应对特征图重要信息进行提取;采用混合空洞卷积获得大感受野同时避免下采样造成的小特征信息丢失;采用分组卷积等设计手段对荔枝5 种叶片病虫害进行训练及测试,结果显示在提高了对荔枝叶片病虫害识别率的同时进一步减少了网络模型的参数量及浮点运算量,为小病斑识别及模型移植到可移动设备提供思路。

1 材料和方法

1.1 试验数据获取

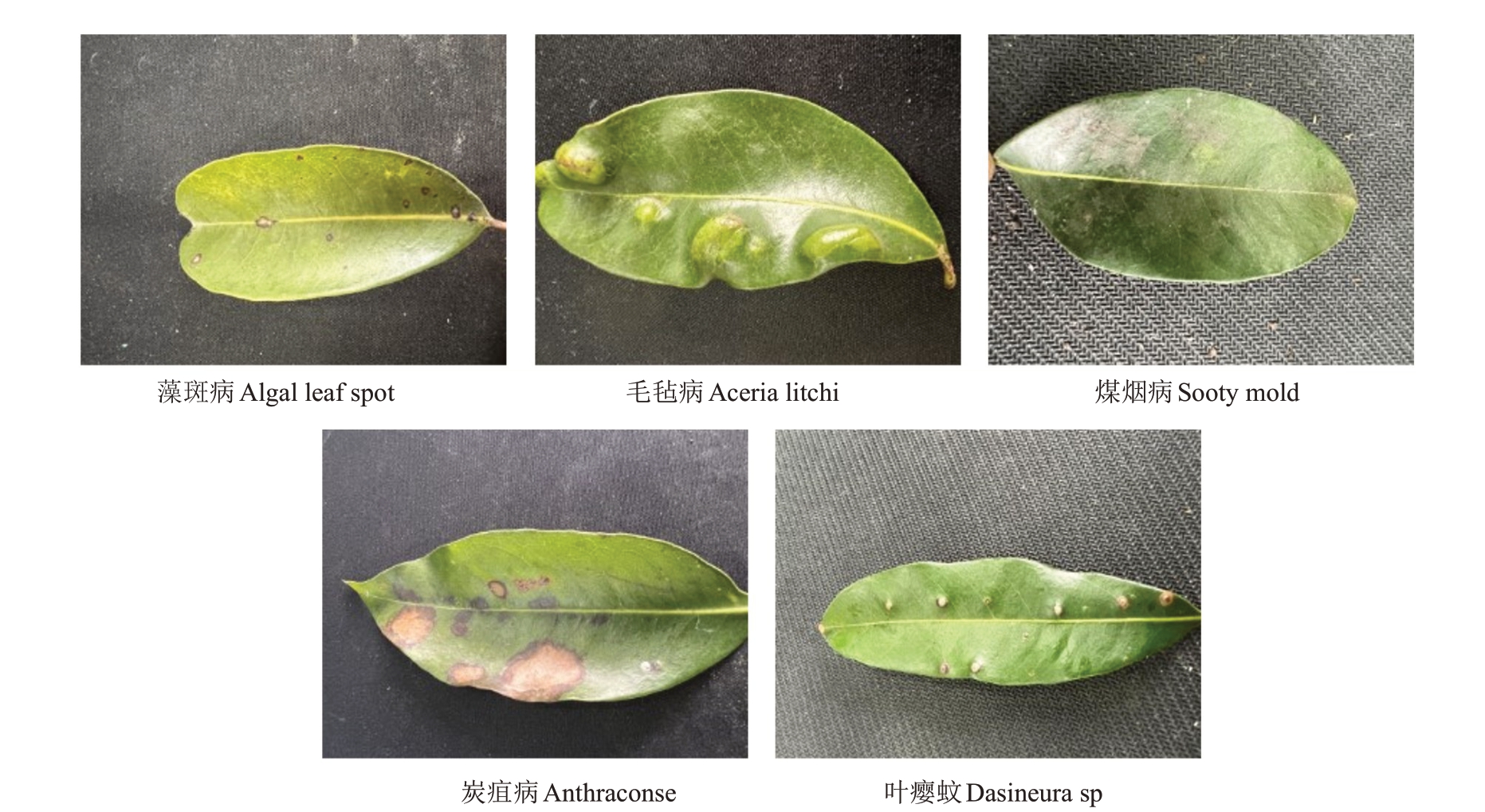

图像数据集在2020年6—10月采集于广东省广州市柯木塱农业技术推广中心的荔枝园,分别采集了荔枝叶片毛毡病、炭疽病、煤烟病、叶瘿蚊、藻斑病5种病虫害图片数据共1160张,5种病虫害数据图片如图1所示。图中显示了叶片病虫害存在着病斑面积大小不一且分布区域广的特点。

图1 不同荔枝病虫害的图像

Fig.1 Images of different litchi diseases

1.2 试验数据扩充

由于卷积神经网络的训练属于监督学习,需要大量的样本进行训练,为避免网络过拟合并增强模型的鲁棒性,因此使用Python 中的开源工具库imgaug 对原始数据集进行数据增强。采用水平镜像翻转、垂直镜像翻转、随机比例裁剪、添加高斯噪声、改变亮度和对比度等随机2~4 种方法叠加增强,增加数据的多样性并将图像尺寸归一化之224×224 像素。增强后数据集共6523 张。随机选取增强后数据集中的80%作为训练集,其余20%作为测试集,扩充后的叶片病虫害种类和数目如表1所示。

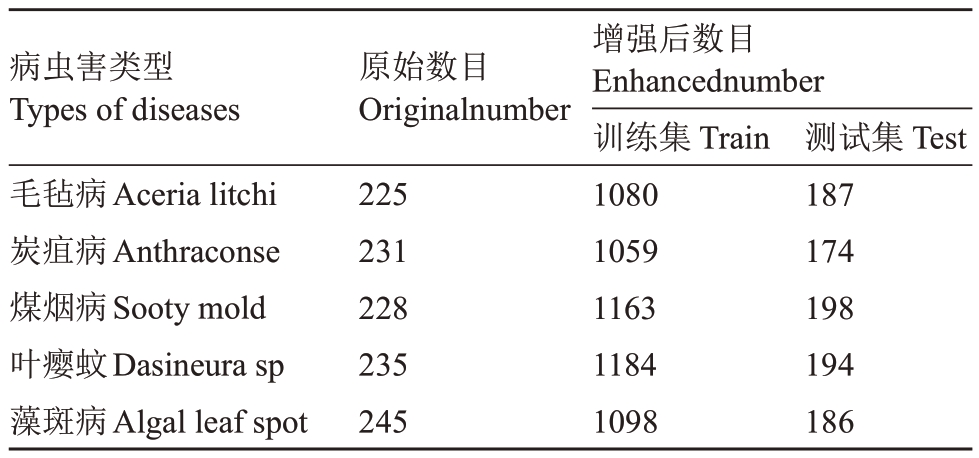

表1 荔枝叶片病虫害数据分布

Table 1 Distribution of litchi leaf disease data

病虫害类型Types of diseases毛毡病Aceria litchi炭疽病Anthraconse煤烟病Sooty mold叶瘿蚊Dasineura sp藻斑病Algal leaf spot原始数目Originalnumber 225 231 228 235 245增强后数目Enhancednumber训练集Train 1080 1059 1163 1184 1098测试集Test 187 174 198 194 186

1.3 方法

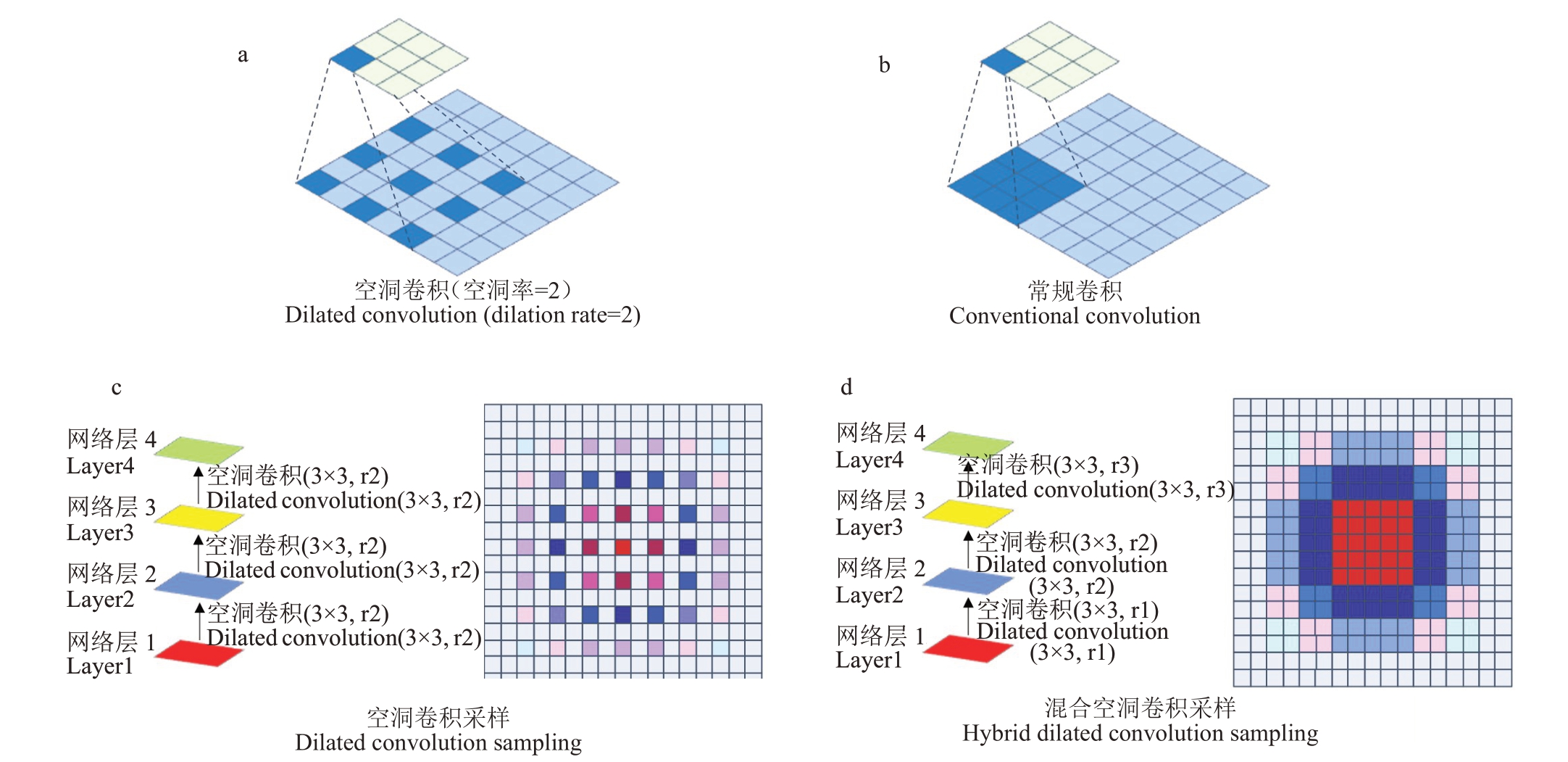

试验运行环境为Windows10(64 位)操作系统,训练基于PyTorch 深度学习框架,编程语言为Python3.8,GPU 为GeForce GTX 1080Ti,CPU 为Intel(R)Core(TM)i7-6800K,CUDA11.0 版本。试验中选取所有图像样本的80%用于训练,剩余20%作为测试集对模型效果进行验证并输出病虫害类别的识别情况。超参数根据文献[24]和本研究对比试验情况进行设置,批处理大小(Batch-size)设置为32,模型的训练轮次为100 epoch,模型训练的优化器选用动量梯度下降算法(gradient descent with momentum),学习率设置为0.01,动量取0.9,为避免模型发生过拟合,在全连接层采用了随机失活(dropout)技术,其参数值设置为0.5。在特征提取模块采用混合空洞卷积,分别设置采用普通卷积、空洞卷积、混合空洞卷积3种不同方式的对照组。通过增加网络感受野方法,在保持图像分辨率的同时能够提供更多的全局信息。空洞卷积(dilated convolution)是在标准的卷积核中注入空洞(图2-a),以此来增加模型的感受野尺寸,见公式(1)。相比原来的普通卷积操作,它以一定的步长跳过输入值,从而覆盖更大的输入[25]。

图2 空洞卷积及其采样示意图

Fig.2 Schematic diagram of dilated convolution and its sampling

式中s表示感受野的大小,d表示空洞率,k表示卷积核大小。

从公式(1)的定义可以看出,相比于标准卷积,空洞卷积可以在不增加参数的情况下获取更大的感受野。如图2-b 所示,3×3 的标准卷积的感受野为3×3,空洞率为2 的3×3 空洞卷积的感受野为5×5。

空洞卷积虽然能够增加感受野,但是如果相同空洞率的卷积层堆叠会造成局部信息的丢失(图2-c)。stage 模块中的分支2 采用混合空洞卷积(hybrid dilated convolution)[26](图2-d)。

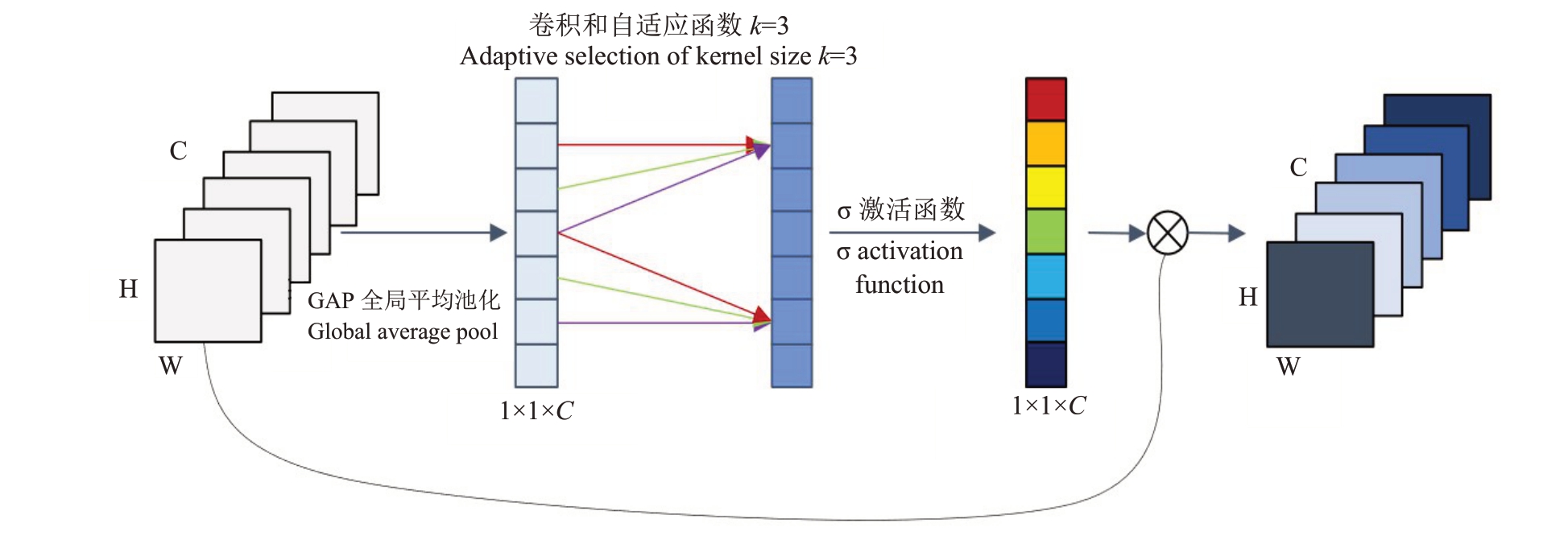

通过嵌入轻量型通道注意力模块ECA,并分别设置了4 个对照组,对模型中嵌入ECA 注意力模块[27]、BAM 注意力模块、SE 注意力模块、CBAM 注意力模块4 种不同注意力模块进行了对比试验。ECA的结构如图3所示。

图3 ECA 注意力模块结构

Fig.3 ECA attention mechanism structure

H.特征图高度;W.特征图宽度;C.特征图通道数;⊗.特征图对应元素相乘。

H.Feature map height;W.Feature map width;C.Number of feature map channels;⊗.Multiply the corresponding elements of the feature map.

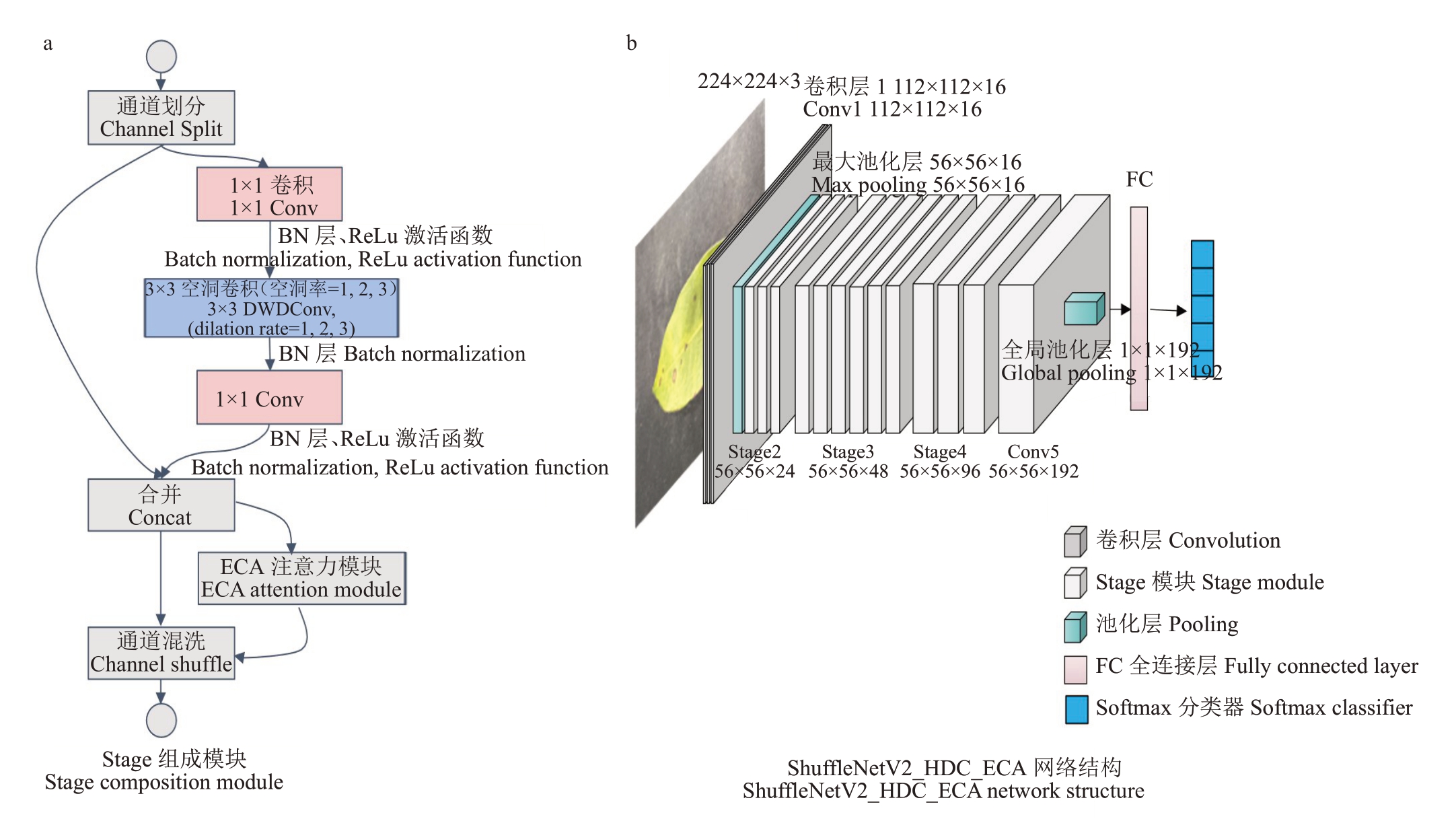

为了达到模型轻量化的目的,将ShuffleNet V2[28-29]结构中的stage2、stage3、stage4 中模块个数调整为3、6、3个,通道数调整为16、24、48、96、192。模型结构如图4所示。

图4 ShuffleNet V2_HDC_ECA 模型结构

Fig.4 ShuffleNet V2_HDC_ECA model structure diagram

设置7个对照组,采用控制单一变量的方式,对混合空洞卷积、ECA注意力模块、模型结构调整3个因素对模型的影响进行了消融试验;最后将模型分别与AlexNet、ResNet-18、DenseNet 和MobileNet V2 4种不同模型进行对比。

1.4 评价指标

为了客观评价改进模型对荔枝病虫害检测分类的性能,本研究中采用5种分类评价指标进行衡量。

1.4.1 查准率(Percision) 是分类器预测的正样本中预测正确的比例,计算公式如下:

式中TP 表示实际为正样本预测为正样本的数量;FP表示实际为负样本预测为正样本的数量,P的值越大表示模型预测结果为正例中实际正例的占比越大。

1.4.2 查全率(Recall) 是分类器预测的正样本占所有正样本的比例,计算公式如下:

式中FN 表示实际为正样本预测为负样本的数量,R 取值越大表示模型真实情况为正例中预测正例的占比越大。

1.4.3 综合分类率(F1-score) 是查准率和查全率的调和平均数,计算公式如下:

式中P 表示模型的查准率;R 表示模型的查全率,F1取值越大表示模型的预测能力越强。

1.4.4 模型参数量(pares) 是模型结构中包含的参数量,参数量越小模型运算所需的内存空间就越小。

1.4.5 浮点运算量(FLOPs) 用来衡量模型的复杂度,FLOPs越小模型越容易移植至移动端。

2 结果与分析

2.1 空洞卷积对模型性能的影响

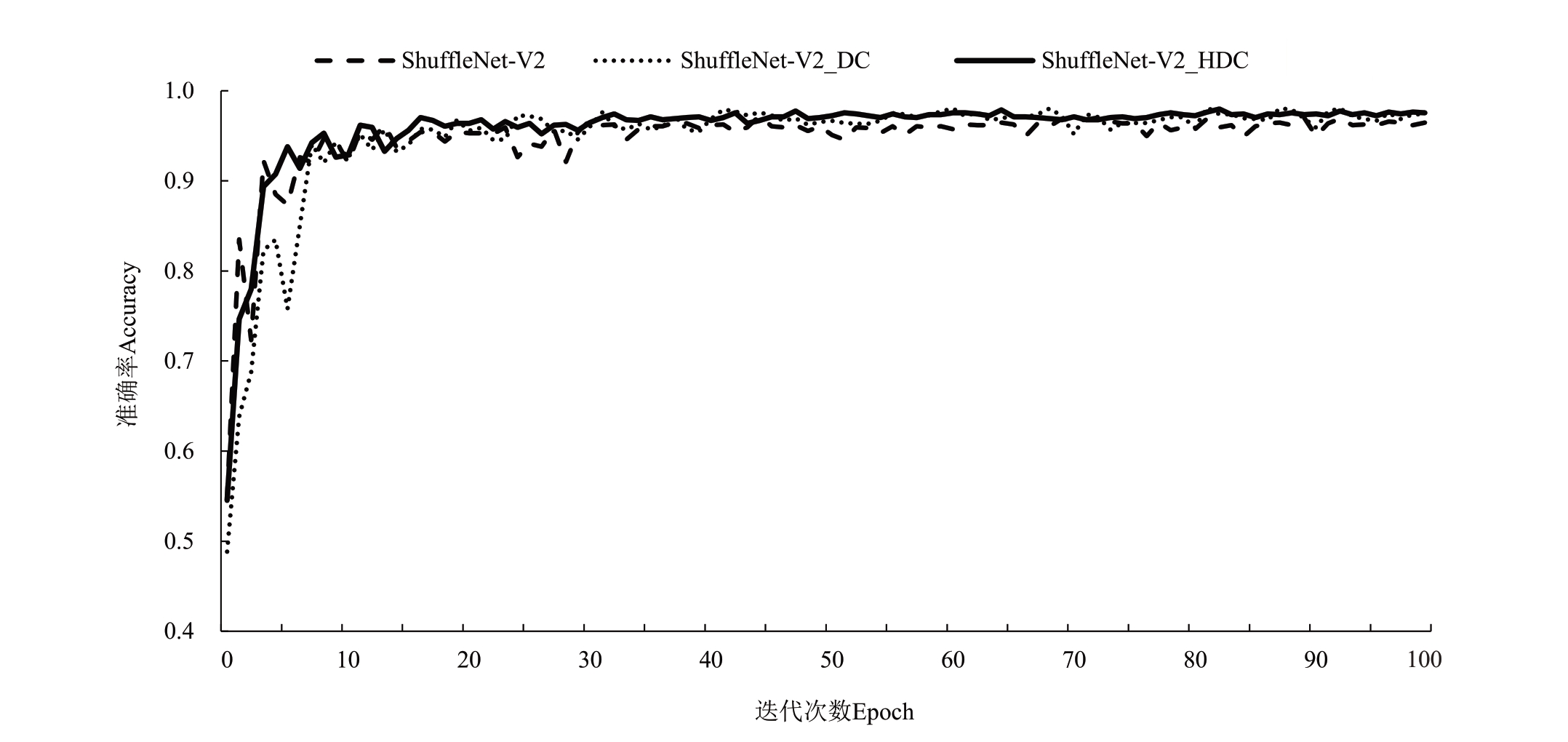

为了验证空洞卷积对ShuffleNet V2 模型识别性能的影响,选择ShuffleNet V2 进行荔枝病虫害识别对比试验,ShuffleNet V2_DC 特征提取模块采用同一尺寸的空洞卷积设计,ShuffleNetV2_HDC特征提取模块采用混合空洞卷积设计,ShuffleNet V2_HDC_ECA 在特征提取模块结合了混合空洞卷积和ECA注意力模块。3种不同结构模型的训练结果如图5所示。

图5 不同模型的测试分类准确率曲线

Fig.5 Test classification accuracy curves under different models

在相同的试验条件下,特征提取模块采用混合空洞卷积搭建的ShuffleNet V2_HDC 模型在识别准确率上优于原ShuffleNet V2和ShuffleNet V2_DC模型,其中ShuffleNet V2_HDC 的最终识别率达到97.55%;而原ShuffleNet V2 模型的最终识别率只有95.53%,说明传统下采样造成了信息损失,识别效果低于采用空洞卷积设计的模型,同时高于ShuffleNet V2_DC模型的96.61%,说明在使用统一尺寸空洞卷积时产生的网格效应造成了部分信息丢失,降低了模型识别效果。

2.2 注意力机制对模型性能的影响

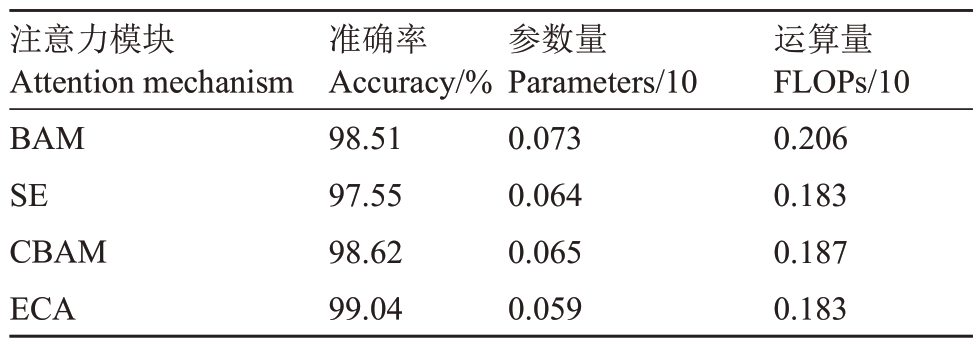

为了验证ECA 注意力模块相比于其他注意力模块对模型的提升效果,在相同试验条件下,使用BAM 注意力模块、SE 注意力模块和CBAM 注意力模块替换本研究使用的ECA 模块进行对比试验。得到网络模型识别结果和模型参数量及运算量,如表2所示。

表2 不同注意力模块性能验证

Table 2 Performance verification test results of different attention mechanisms

注意力模块Attention mechanism BAM SE CBAM ECA准确率Accuracy/%98.51 97.55 98.62 99.04参数量Parameters/10 0.073 0.064 0.065 0.059运算量FLOPs/10 0.206 0.183 0.187 0.183

从表2 可以看出,与其他注意力模块对比,本研究模型添加的ECA 注意力模块参数量和运算量最少,性能表现最好。其中SE、BAM 以及CBAM 3 种注意力模块都存在压缩通道降维操作,不利于学习通道之间的依赖关系,缺少相邻通道之间的信息交互,适当的跨通道信息交互可以显著降低模型复杂度的同时保持性能。研究采用的ECA注意力模块在不压缩维度的情况下进行跨通道交互学习,有助于模型学习荔枝病虫害特征通道之间的信息交互和依赖关系,进一步提升了模型识别性能。

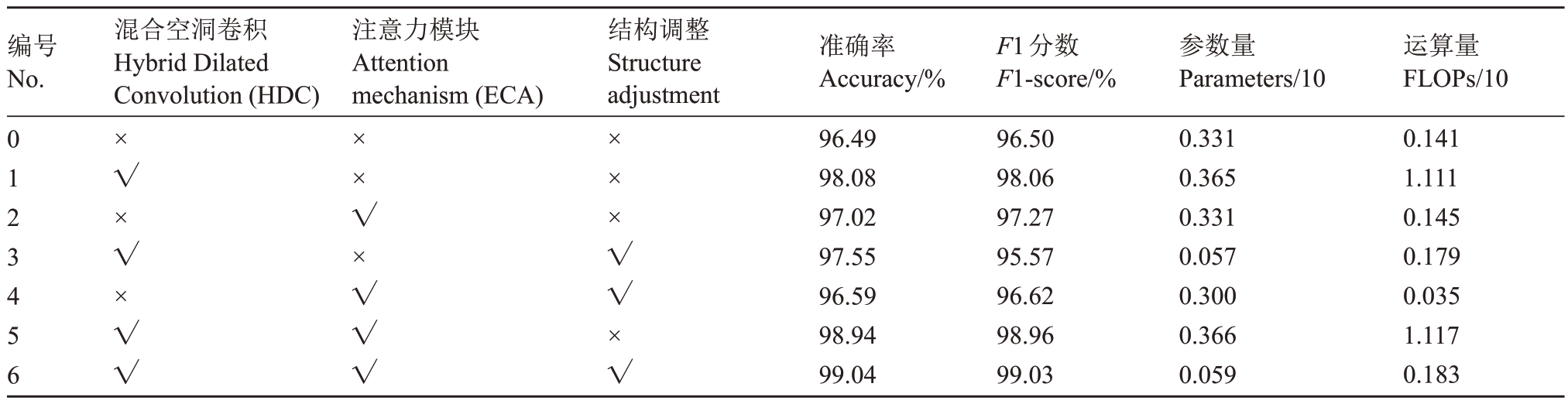

2.3 模型的消融实验结果

为了探究使用HDC混合空洞卷积、ECA注意力模块和结构调整的改进方式对ShuffleNet V2 模型带来的性能提升效果,进行消融试验,结果如表3所示。

表3 ShuffleNet V2_HDC_ECA 模型的消融试验

Table 3 Ablation experiment of ShuffleNet V2_HDC_ECA model

注:×表示未使用该改进方法;√表示使用了该改进方法。

Note:×indicates that the improved method is not used;√indicates that the improved method is used.

编号No.0123456混合空洞卷积Hybrid Dilated Convolution(HDC)×√×√×√√注意力模块Attention mechanism(ECA)××√×√√√结构调整Structure adjustment×××√√×√准确率Accuracy/%96.49 98.08 97.02 97.55 96.59 98.94 99.04 F1分数F1-score/%96.50 98.06 97.27 95.57 96.62 98.96 99.03参数量Parameters/10 0.331 0.365 0.331 0.057 0.300 0.366 0.059运算量FLOPs/10 0.141 1.111 0.145 0.179 0.035 1.117 0.183

从表3 中可以看出,在ShuffleNet V2 中采用HDC混合空洞卷积代替传统卷积,模型的准确率提升了1.59 个百分点,F1 分数提升了1.56 个百分点,模型的参数量减少了1/3,模型的运算量增加较多。将ECA 注意力模块添加到ShuffleNet V2 的基本单元中,模型的准确率和F1 分数均得到了提升,分别为0.53 个百分点和0.77 个百分点,模型参数量和运算量变化较小。综合HDC混合空洞卷积、ECA注意力模块的改进,ShuffleNet V2 的性能得到了较大的提升,准确率和F1分数分别提升了2.45个百分点和2.46 个百分点,但是参数量增加了,运算量增加了。通过对模型的结构进行调整,显著降低了模型的参数量和运算量。 最终提出的ShuffleNet V2_HDC_ECA 轻量化模型的识别率为99.04%,F1分数为99.03%,较改进前的ShuffleNet V2模型提高了2.55 个百分点和2.53 个百分点,而参数量和浮点运算量分别为0.059 G和0.183 M。

为了更直观地展示本研究提出的ShuffleNet V2_HDC_ECA轻量化模型的有效性,使用类激活图(CAM)对病虫害进行可视化分析。CAM能够以热力图的形式显示模型在训练过程中权重或重心在何处、如何转移,分类模型是根据哪一部分的特征进行判断[30]。图6给出了叶瘿蚊图像在不同模型下的类激活特征热力图及中间特征图。在ShuffleNet V2模型中,下采样的分辨率下降导致底层的病斑小特征点的信息丢失,提取到了叶片的边缘但没有提取到病斑特征;使用统一尺寸的空洞卷积设计的ShuffleNet V2_DC_ECA模型,对叶片病斑的特征提取存在不足,由于网格效应造成的部分信息丢失,不能够提取到所有的病斑信息;研究模型ShuffleNet V2_HDC_ECA,在增大感受视野的同时避免了下采样和网格效应造成的小特征信息丢失,准确提取到了病斑特征点。针对荔枝病虫害的病斑分布范围广、面积大小不一的特点,本研究改进的特征提取模块能够更好地学习到全局信息,从而提升了模型分类性能。

图6 特征提取模块stage3 中特征图可视化结果

Fig.6 Feature map visualization results in the feature extraction module stage3

2.4 与其他模型性能的对比

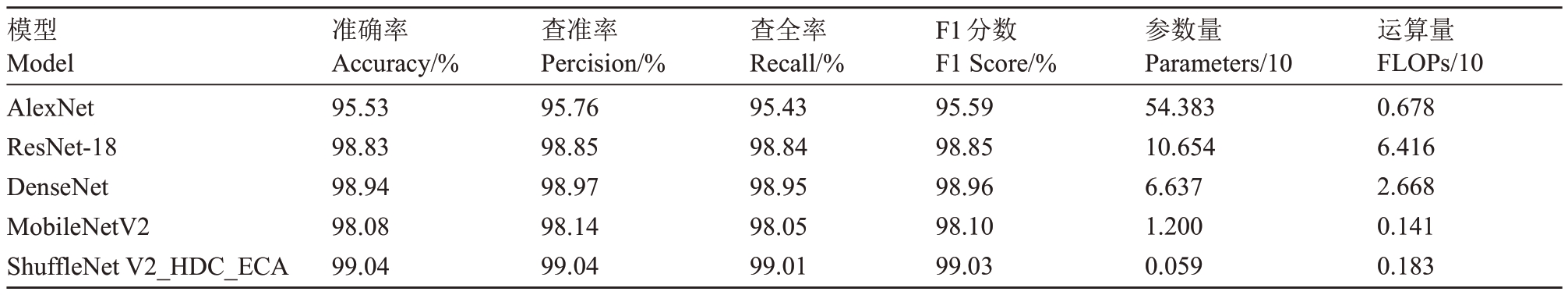

为进一步验证所设计的模型识别荔枝病虫害的效果,基于模型竞争力角度选择AlexNet、ResNet-18、DenseNet 和MobileNetV2 作为对比模型进行对比试验,在相同的试验条件下进行对比(表4)。

表4 不同网络模型的性能对比

Table 4 Performance comparison of different network models

模型Model AlexNet ResNet-18 DenseNet MobileNetV2 ShuffleNet V2_HDC_ECA准确率Accuracy/%95.53 98.83 98.94 98.08 99.04查准率Percision/%95.76 98.85 98.97 98.14 99.04查全率Recall/%95.43 98.84 98.95 98.05 99.01 F1分数F1 Score/%95.59 98.85 98.96 98.10 99.03参数量Parameters/10 54.383 10.654 6.637 1.200 0.059运算量FLOPs/10 0.678 6.416 2.668 0.141 0.183

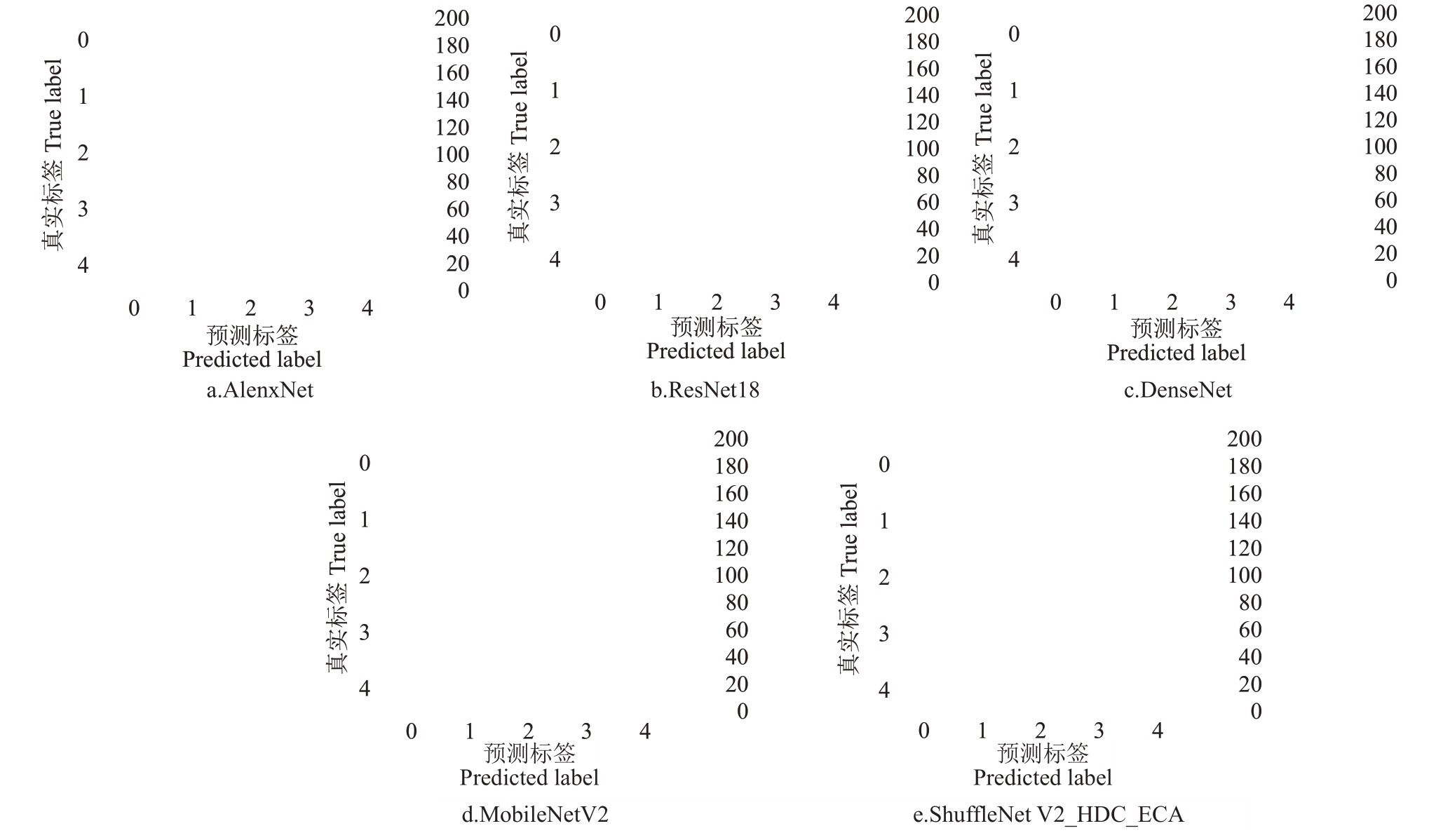

从表4 可以看出,不同的网络架构对荔枝叶片病虫害识别效果不同,ShuffleNet V2_HDC_ECA 的识别率达到了99.04%,参数量和运算量远远小于AlexNet、ResNet-18、DenseNet,因此改进的模型在识别准确率和参数量、运算量之间取得了良好的平衡,能够应用于移动端等算力有限设备对荔枝叶片病虫害的识别。并且图7的混淆矩阵显示,5种病虫害中炭疽病和烟煤病容易被误识别,本研究通过保留更多底层微小病斑特征而能够有着较低的误识别率。

图7 不同网络模型识别结果的混淆矩阵

Fig.7 Confusion matrix of recognition results of different network models

0,1,2,3,4 分别代表荔枝毛毡病、炭疽病、煤烟病、叶瘿蚊、藻斑病。

0,1,2,3,and 4 represent Aceria litchi,Anthraconse,Sooty mold,Dasineura sp,Algal leaf spot,respectively.

3 讨 论

研究在原ShuffleNet V2 模型结构的基础上,采用混合空洞卷积替换了模型中的常规卷积、嵌入ECA注意力模块和缩减及删除了不必要的网络层数及通道数等方法并进行了对比试验。

笔者在本研究中分析了普通卷积、空洞卷积和混合空洞卷积对网络性能的影响,分别使用不同的下采样方式设置对照组进行了验证。发现在图像分类的任务中,感兴趣区域往往分布在图像的多个区域,需要更多的全局信息及更高层的特征信息才能更好地识别目标。感受野越小,它对应的原始图像的范围就越小,意味着它包含的特征更加趋近于局部和细节,而用来处理复杂任务的高级语义信息很难被网络捕捉;感受野越大,它对应的原始图像的范围就越大,意味着它蕴含更多全局的、语义层次更高的特征。在实际环境中,荔枝叶片病虫害存在着病斑面积大小不一、病虫害分布范围广等问题。采用混合空洞卷积能够提高特征信息的提取,避免了下采样分辨率下降而导致的小特征信息丢失问题。本研究与孙俊等对网络中不同尺寸的特征图采取上采样融合操作,构建兼具网络高、低层信息的新特征图避免了特征信息丢失的作用一样[31],但本研究采用混合空洞卷积在不需要增加卷积层的情况下便得到更大的感受野不会增加网络的参数量及计算量。

注意力机制能够更好地聚集网络模型对待识别目标的特征信息,减少无关背景的影响。常用的注意力模块SE模块中,主要由全局平均池化层(golbal average pooling,GAP)、全连接层(fully connected,FC)和Sigmoid 函数组成。两个FC 层的设计是为了捕捉非线性的跨通道交互,其中包括采用降维操作来控制模型的复杂度,在SE模块中进行降维操作对通道预测效果造成负面影响,捕获所有通道之间的依赖是低效的。因此,本研究选用由SE 变化改进的ECA注意力模块,该注意力模块采用了一种不降维的局部跨通道交互策略和自适应选择一维卷积核大小的方法,通过一维卷积层汇总跨通道信息的方法获取更加精确的注意力信息。该注意力模块首先将输入特征图进行全局平均池化操作,接着进行卷积核大小为K 的一维卷积进行卷积操作并经过sigmoid 激活函数得到各个通道的权重,最后将各通道权重与对应原始通道权重相乘得到输出特征图。由于荔枝叶片病虫害的识别主要依据病斑的颜色、形状和纹理,在传统的网络模型中加入ECA注意力模块能够增加网络权重分配给病斑这一分类的关键信息量。

使用混合空洞卷积虽然避免了下采样造成的信息损失,但这同时产生了巨大的运算量。在引入混合空洞卷积后保证了分辨率不变且能够很好地提取到叶片病斑的特征,以及嵌入了ECA注意力模块能够更加有效地使用通道信息,图像数据不需要更深的网络层数和更多的通道数即可获得最终的分类结果,可以进一步对网络模型进行结构调整减少模型的参数量及浮点计算量。在轻量型网络的研究方面,平衡了准确率、模型参数量和浮点计算量这3个指标,部署在移动终端等嵌入式资源受限设备上,是后续研究的内容之一。

4 结 论

针对荔枝叶片病虫害的识别,以5 种不同荔枝病虫害图像作为研究对象,通过实地采集的1160张图像构建了荔枝叶片病虫害种类识别图像数据集。在原ShuffleNet V2 模型结构的基础上,采用混合空洞卷积替换了模型中的常规卷积、嵌入ECA注意力模块、缩减或删除了不必要的网络层数及通道数等方法并进行了对比试验。

(1)相对于传统分类模型仅依靠网络高层信息进行分类,采用混合空洞卷积进行采样避免了下采样分辨率下降而导致的小特征信息丢失问题,表明本研究的方法能够针对荔枝叶片病虫害特点强化对病斑的特征提取,识别准确率达到了99.04%。

(2)通过与不同的注意力模块进行对比试验,采用ECA 注意力模块自适应提取对识别目标重要的通道信息,在增加少量参数的情况下提升模型识别准确率。

(3)识别模型的试验结果表明,在特征提取中保持高分辨率能够获得更好的分类效果,并且能够在达到识别效果的前提下进一步删减模型网络层数及通道数,有利于将卷积神经网络模型部署在移动终端等嵌入式资源受限设备上。

[1] 庄丽娟,邱泽慧. 2019 年中国荔枝产业发展特征与政策建议[J]. 中国南方果树,2021,50(4):184-188.ZHUANG Lijuan,QIU Zehui. Development characteristics and policy recommendations of China’s lychee industry in 2019[J].South China Fruits,2021,50(4):184-188.

[2] 向旭.广东荔枝产业发展瓶颈与产业技术研发进展[J].广东农业科学,2020,47(12):32-41.XIANG Xu.Bottleneck of litchi industry development and progress of technology research and deveopment[J]. Guangdong Agricultural Sciences,2020,47(12):32-41.

[3] 黄康泉.荔枝主要病虫害的危害症状及防治方法[J].现代园艺,2021,44(22):40-41.HUANG Kangquan. Symptoms and control methods of main diseases and insect pests of litchi[J]. Contemporary Horticulture,2021,44(22):40-41.

[4] 谢堂胜,刘德营,陈京,蔡俊.白背飞虱智能识别技术研究[J].南京农业大学学报,2016,39(3):519-526.XIE Tangsheng,LIU Deying,CHEN Jing,CAI Jun. Automatic identification of Sogatella furcifera[J]. Journal of Nanjing Agricultural University,2016,39(3):519-526.

[5] BARMAN U,CHOUDHURY R D,SAHU D,BARMAN G G.Comparison of convolution neural networks for smartphone image based real time classification of citrus leaf disease[J]. Computers and Electronics in Agriculture,2020,177:105661.

[6] SINGH V,MISRA A K. Detection of plant leaf diseases using image segmentation and soft computing techniques[J]. Information Processing in Agriculture,2017,4(1):41-49.

[7] HLAING C S,MAUNG ZAW S M.Tomato plant diseases classification using statistical texture feature and color feature[C]//2018 IEEE/ACIS 17th International Conference on Computer and Information Science(ICIS).IEEE,2018:439-444.

[8] 党满意,孟庆魁,谷芳,顾彪,胡耀华.基于机器视觉的马铃薯晚疫病快速识别[J].农业工程学报,2020,36(2):193-200.DANG Manyi,MENG Qingkui,GU Fang,GU Biao,HU Yaohua.Rapid recognition of potato late blight based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering,2020,36(2):193-200.

[9] 翟肇裕,曹益飞,徐焕良,袁培森,王浩云.农作物病虫害识别关键技术研究综述[J].农业机械学报,2021,52(7):1-18.ZHAI Zhaoyu,CAO Yifei,XU Huanliang,YUAN Peisen,WANG Haoyun. Review of key techniques for crop disease and pest detection[J]. Transactions of the Chinese Society for Agricultural Machinery,2021,52(7):1-18.

[10] 卜俊怡,孙国祥,王迎旭,魏天翔,汪小旵.基于诱虫板图像的温室番茄作物害虫识别与监测方法[J].南京农业大学学报,2021,44(2):373-383.BU Junyi,SUN Guoxiang,WANG Yingxu,WEI Tianxiang,WANG Xiaochan. Identification and monitoring method of tomato crop pests in greenhouse based on trapping board image[J].Journal of Nanjing Agricultural University,2021,44(2):373-383.

[11] LECUN Y,BENGIO Y,HINTON G. Deep learning[J]. Nature,2015,521:436-444.

[12] LECUN Y,KAVUKCUOGLU K,FARABET C. Convolutional networks and applications in vision[C]//Proceedings of 2010 IEEE international symposium on circuits and systems. IEEE,2010:253-256.

[13] 鲍文霞,孙庆,胡根生,黄林生,梁栋,赵健.基于多路卷积神经网络的大田小麦赤霉病图像识别[J].农业工程学报,2020,36(11):174-181.BAO Wenxia,SUN Qing,HU Gensheng,HUANG Linsheng,LIANG Dong,ZHAO Jian. Image recognition of field wheat scab based on multi-way convolutional neural network[J].Transactions of the Chinese Society of Agricultural Engineering,2020,36(11):174-181.

[14] ZHANG S W,ZHANG S B,ZHANG C L,WANG X F,SHI Y.Cucumber leaf disease identification with global pooling dilated convolutional neural network[J]. Computers and Electronics in Agriculture,2019,162:422-430.

[15] LIU Z Y,GAO J F,YANG G G,ZHANG H,HE Y.Localization and classification of paddy field pests using a saliency map and deep convolutional neural network[J].Scientific Reports,2016,6(1):1-12.

[16] VASWANI A,SHAZEER N,PARMAR N,USZKOREIT J,JONES L,GOMEZ A N,KAISER L,POLOSUKHIN I. Attention is all you need[C]. In Advances in Neural Information Processing Systems,2017:6000-6010.

[17] 张宸嘉,朱磊,俞璐. 卷积神经网络中的注意力机制综述[J].计算机工程与应用,2021,57(20):64-72.ZHANG Chenjia,ZHU Lei,YU Lu.Review of attention mechanism in convolutional neural networks[J]. Computer Engineering and Applications,2021,57(20):64-72.

[18] HU J,SHEN L,SUN G,ALBANIE S,WU E H.Squeeze and excitation networks[C]//Proceedings of the IEEE conference on computer vision and pattern recognition.IEEE,2018:7132-7141.

[19] HUANG Z L,WANG X G,WEI Y C,HUANG L C,SHI H,LIU W Y,HUANG T S.CCNet:Criss-cross attention for semantic segmentation[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision.IEEE,2019:603-612.

[20] FU J,LIU J,TIAN H J,LI Y,BAO Y J,FANG Z W,LU H Q.Dual attention network for scene segmentation[C]//Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.IEEE,2020:3141-3149.

[21] CHEN J D,CHEN W R,ZEB A,ZHANG D F,NANEHKARAN Y A. Crop pest recognition using attention-embedded lightweight network under field conditions[J].Applied Entomology and Zoology,2021,56(4):427-442.

[22] ZHAO Y,CHEN J G,XU X,LEI J S,ZHOU W J.SEV-Net:residual network embedded with attention mechanism for plant disease severity detection[J]. Concurrency and Computation:Practice and Experience,2021,33(10):e6161.1-e6161.18.

[23] 王美华,吴振鑫,周祖光.基于注意力改进CBAM 的农作物病虫害细粒度识别研究[J]. 农业机械学报,2021,52(4):239-247.WANG Meihua,WU Zhenxin,ZHOU Zuguang. Fine-grained identification research of crop pests and diseases based on improved CBAM via attention[J]. Transactions of the Chinese Society for Agricultural Machinery,2021,52(4):239-247.

[24] [MISHKIN D,NIKOLAY S,JIRI M. Systematic evaluation of convolution neural network advances on the imagenet[J]. Computer Vision and Image Understanding,2017,161:11-19.

[25] YU F,KOLTUN V,FUNKHOUSER T. Dilated residual networks[C]//Proceedings of the IEEE conference on computer vision and pattern recognition.IEEE,2017:636-644.

[26] WANG P Q,CHEN P F,YUAN Y,LIU D,HUANG Z H,HOU X D,COTTRELL G. Understanding convolution for semantic segmentation[C]//2018 IEEE winter conference on applications of computer vision(WACV).IEEE,2018:1451-1460.

[27] WANG Q L,WU B G,ZHU P F,LI P H,ZUO W M,HU Q H.ECA-Net:Efficient channel attention for deep convolutional neural networks[C]//Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. IEEE,2020:11531-11539.

[28] NINGNING M,ZHANG X Y,ZHENG H T,SUN J. ShuffleNet V2:Practical guidelines for efficient CNN architecture design[C]//European Conference on Computer Vision. Cham,Springer,2018:122-138.

[29] 张珂,冯晓晗,郭玉荣,苏昱坤,赵凯,赵振兵,马占宇,丁巧林.图像分类的深度卷积神经网络模型综述[J].中国图象图形学报,2021,26(10):2305-2325.ZHANG Ke,FENG Xiaohan,GUO Yurong,SU Yukun,ZHAO Kai,ZHAO Zhenbing,MA Zhanyu,DING Qiaolin.Overview of deep convolutional neural networks for image classification[J].Journal of Image and Graphics,2021,26(10):2305-2325.

[30] ZHOU B L,KHOSLA A,LAPEDRIZA A,OLIVA A,TORRALBA A.Learning deep features for discriminative localization[C]//Proceedings of the IEEE conference on computer vision and pattern recognition.IEEE,2016:2921-2929.

[31] 孙俊,朱伟栋,罗元秋,沈继锋,陈义德,周鑫.基于改进MobileNet-V2 的田间农作物叶片病害识别[J]. 农业工程学报,2021,37(22):161-169.SUN Jun,ZHU Weidong,LUO Yuanqiu,SHEN Jifeng,CHEN Yide,ZHOU Xin. Recognizing the diseases of crop leaves in fields using improved Mobilenet-V2[J].Transactions of the Chinese Society of Agricultural Engineering,2021,37(22):161-169.